Reddit e Quora capturaram 52,5% das citações de IA em janeiro-fevereiro de 2026, enquanto marcas ficaram com 47,5%. Essa diferença não vem de conteúdo melhor. Vem de acessibilidade técnica: os crawlers conseguem ler essas plataformas sem obstáculos.

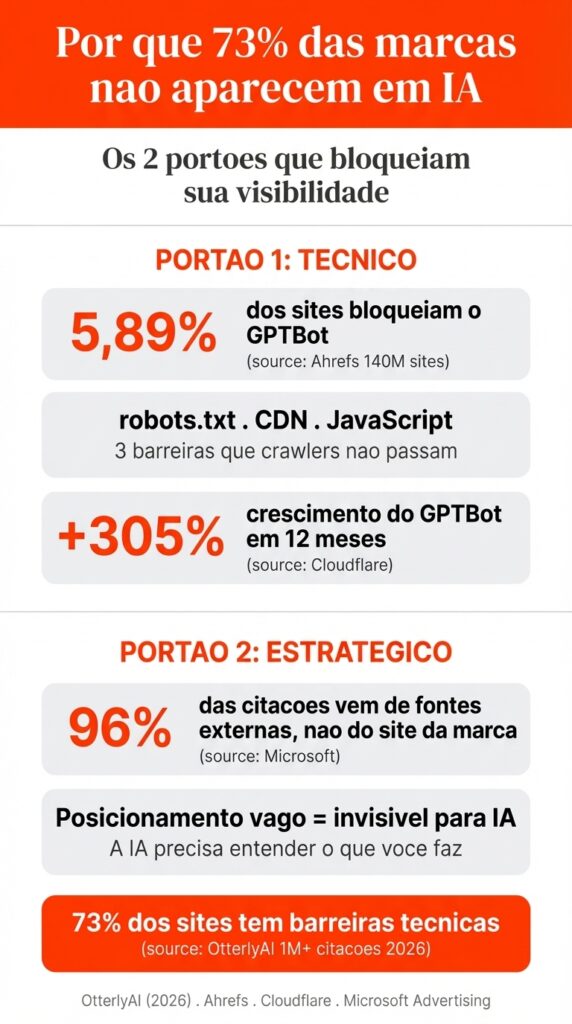

Existem dois portões que impedem marcas de aparecer no ChatGPT, Perplexity e Google AI Overviews. O portão técnico bloqueia o crawler antes que ele chegue ao conteúdo. O portão estratégico bloqueia a recomendação mesmo quando o crawler consegue ler. Resolver apenas um não resolve nada.

Pontos Importantes

- 73% dos sites têm barreiras técnicas que bloqueiam crawlers de IA – a maioria sem saber

- Resolver só o técnico não garante visibilidade: existe um segundo portão estratégico

- Reddit aparece mais porque é tecnicamente acessível, não porque tem conteúdo melhor

- Bloquear crawlers de IA tem custo real: publishers perderam 14% do tráfego humano

- Os dois portões precisam ser abertos juntos

O portão técnico: por que crawlers de IA não conseguem ler 73% dos sites

O portão técnico bloqueia 73% dos sites antes que qualquer questão de conteúdo entre em jogo. São três barreiras: robots.txt configurado para rejeitar crawlers de IA, regras de CDN que bloqueiam user-agents não-navegador, e conteúdo renderizado em JavaScript que esses crawlers não conseguem executar. A maioria desses bloqueios é involuntária – configurações padrão criadas sem considerar os novos user-agents de IA.

Fonte: OtterlyAI, análise de 1M+ citações, jan-fev 2026

Barreira 1 – robots.txt bloqueando GPTBot, ClaudeBot e PerplexityBot

Segundo análise da Ahrefs de 140 milhões de sites, 5,89% de todos os sites bloqueiam o GPTBot – o que equivale a 8,2 milhões de domínios. ClaudeBot e Anthropic-ai estão bloqueados em cerca de 5,7% cada. Esses números subestimam o problema real: muitas configurações padrão de robots.txt usam regras genéricas que inadvertidamente excluem crawlers de IA sem o proprietário do site perceber.

Existe uma distinção que poucas pessoas fazem. Crawlers de IA têm dois modos distintos:

- Crawlers de treinamento (GPTBot-training, Common Crawl): coletam dados para retreinar modelos. Bloquear esses não impacta sua visibilidade em respostas em tempo real.

- Crawlers de retrieval (ChatGPT-User, OAI-Searchbot, PerplexityBot, ClaudeBot): alimentam respostas em tempo real. Bloquear esses significa desaparecer das respostas do ChatGPT e do Perplexity agora.

Como verificar: abra seusite.com/robots.txt e busque os termos GPTBot, ChatGPT-User, ClaudeBot, PerplexityBot, OAI-Searchbot. Se algum desses tiver Disallow: /, sua marca está invisível para aquele sistema de IA.

Para corrigir, adicione ao robots.txt:

User-agent: GPTBot

Allow: /

User-agent: ChatGPT-User

Allow: /

User-agent: ClaudeBot

Allow: /

User-agent: PerplexityBot

Allow: /

User-agent: OAI-Searchbot

Allow: /

O contexto de crescimento torna isso urgente. A Cloudflare registrou aumento de 305% no tráfego do GPTBot entre maio de 2024 e maio de 2025. Esses crawlers são uma força crescente, e quem os bloqueia agora vai precisar de tempo para recuperar a presença perdida depois.

Barreira 2 – CDN bloqueando user-agents não-navegador

CDNs como Cloudflare, AWS CloudFront e Akamai têm regras de segurança que identificam user-agents não-navegador como atividade suspeita e os bloqueiam automaticamente. Isso acontece mesmo quando o robots.txt está configurado corretamente – o CDN age antes da requisição chegar ao servidor.

É a barreira mais invisível: o robots.txt pode estar perfeito, o conteúdo pode ser excelente, mas o CDN silenciosamente retorna 403 ou 429 para o GPTBot.

Como verificar: curl -A "GPTBot" https://seusite.com/pagina-importante. Se o retorno for diferente de 200, o CDN está bloqueando.

Como corrigir: adicionar os user-agents de IA ao allowlist do CDN. No Cloudflare, isso fica em Security > WAF > Tools, onde é possível criar regras de permissão por user-agent string.

Barreira 3 – JavaScript que os crawlers não conseguem renderizar

Crawlers de IA têm capacidade limitada de executar JavaScript. Conteúdo que depende de JS para aparecer no DOM simplesmente não existe para eles. Sites construídos com React, Vue ou Angular no modelo client-side rendering são especialmente vulneráveis.

Segundo análise da Linkflow sobre crawlabilidade para IA: “JavaScript é a maior barreira técnica única à visibilidade em IA.” O Google Rich Results Test permite comparar o HTML renderizado com o código-fonte. Se o conteúdo principal aparece no renderizado mas não no HTML cru, crawlers de IA provavelmente não estão vendo.

Como corrigir: Server-Side Rendering (SSR) ou Static Site Generation (SSG) para páginas estratégicas. Não é necessário migrar o site inteiro – priorizar homepage, páginas de produto e artigos de blog com maior potencial de citação.

O portão estratégico: quando a IA consegue ler mas não consegue entender

O portão estratégico bloqueia marcas que conseguem ser rastreadas mas não conseguem ser entendidas. Quando alguém pergunta para uma IA “qual empresa resolve X problema”, marcas que não articulam explicitamente esse problema ficam fora da resposta – independentemente da qualidade do conteúdo.

Queries longas vs keywords: como a busca mudou

As buscas mudaram de palavras-chave isoladas para parágrafos que descrevem contexto, restrições e urgência. De acordo com David Edelman, especialista em marketing, streaming, scrolling, searching e shopping viraram uma coisa só. A IA quebra essas consultas longas em dezenas de buscas simultâneas e sintetiza em segundos.

A implicação prática: quando alguém digita “CRM” no Google, aparece quem ranqueia para “CRM”. Quando alguém pergunta ao ChatGPT “preciso de um software para gerenciar follow-ups da equipe de vendas de uma empresa de 50 pessoas no Brasil com integração com WhatsApp”, a IA precisa entender o que cada empresa resolve especificamente. Marcas com posicionamento vago – “especialistas em soluções digitais” – não aparecem. Marcas com posicionamento específico aparecem.

Posicionamento explícito: o que a IA consegue e não consegue entender

Segundo Jean-Yves Scauri, AI Search Strategist, em entrevista ao blog da Microsoft Advertising, apenas 4% das citações que uma marca recebe em respostas de IA vêm do próprio site. Os outros 96% vêm de fontes terceiras – publishers, reviews, fóruns. A IA não está lendo seu site e repetindo o que você diz. Está consultando o contexto inteiro.

Para aparecer, a marca precisa de clareza em dois níveis. No próprio site: páginas que articulam claramente o problema que resolve, para quem e como – não “somos líderes em inovação”, mas o que a empresa faz de concreto. No contexto externo: menções em publishers, reviews e fóruns que validam o que a marca afirma sobre si mesma. Uma empresa que se chama de líder mas nenhum terceiro confirma isso na web não vai aparecer.

Dados estruturados (schema.org) ajudam nesse processo – permitem que a IA entenda entidades claramente: nome da empresa, produto, problema resolvido, público-alvo.

Por que resolver só um portão não funciona

Corrigir o robots.txt sem ajustar o posicionamento resulta em crawlers que chegam ao site mas não entendem o que a marca faz. Criar conteúdo excelente com posicionamento claro enquanto o CDN bloqueia todos os crawlers resulta em zero citações. Os dois portões precisam ser resolvidos juntos.

O cenário 1: uma empresa corrige o robots.txt, permite todos os crawlers, mas tem páginas com “oferecemos soluções para o seu negócio crescer”. O ChatGPT consegue ler, mas não sabe o que recomendar quando alguém descreve o problema específico que essa empresa resolve.

O cenário 2: uma empresa tem blog de alto nível, posicionamento claríssimo, conteúdo citável – mas o CDN da AWS tem uma regra padrão que bloqueia user-agents desconhecidos. GPTBot e ChatGPT-User nunca chegam às páginas.

Por que agir agora: tráfego de LLMs cresceu 3x ao longo de 2025 e converte a 18%, segundo análise de Jason Tabeling na Search Engine Land com 13 meses de dados. Quem resolve os dois portões neste momento entra numa janela de vantagem antes que a maioria das marcas brasileiras perceba o problema.

O trade-off que ninguém fala: o custo de bloquear crawlers

Grandes publishers que bloquearam crawlers de IA perderam 23% do tráfego total – e, o dado mais contraintuitivo, 14% especificamente de visitantes humanos. O tráfego humano caiu porque parte dele chegava ao site via referências de ferramentas de IA. Bloquear os crawlers cortou esse fluxo.

O estudo é de Hangcheng Zhao (Rutgers Business School) e Ron Berman (The Wharton School, University of Pennsylvania), publicado no arXiv em dezembro de 2025. Analisaram dados de tráfego de 500+ publishers e comportamento de bloqueio via registros históricos de robots.txt do HTTP Archive, cobrindo 2023 e 2024. Alguns publishers reverteram a decisão depois de ver os números.

A distinção que o estudo deixa clara: crawlers de treinamento (GPTBot-training, Common Crawl) podem ser bloqueados sem impacto direto na visibilidade em tempo real. Crawlers de retrieval (ChatGPT-User, OAI-Searchbot, PerplexityBot, ClaudeBot-Search) são os que alimentam respostas do ChatGPT e do Perplexity agora. Bloquear esses é bloquear visibilidade.

Uma nota de cautela sobre os dados: o estudo é correlacional. E robots.txt é não-vinculante – bots podem ignorar. Mas a direção do efeito está documentada e vale considerar antes de qualquer decisão de bloqueio.

Checklist de auditoria: 10 diagnósticos para encontrar seus bloqueios

Use este checklist para identificar em qual portão sua marca está presa. O bloco técnico verifica se crawlers conseguem acessar o site. O bloco estratégico verifica se eles conseguem entender o que você faz.

BLOCO A – Diagnóstico técnico:

- Abra

seusite.com/robots.txt. ExisteDisallowpara GPTBot, ChatGPT-User, ClaudeBot ou PerplexityBot? - Execute

curl -A "GPTBot" https://seusite.comno terminal. O retorno é 200 OK ou código de erro? - Seu site usa React, Vue ou Angular no lado do cliente para renderizar o conteúdo principal?

- Suas regras de CDN (Cloudflare, AWS, Akamai) bloqueiam user-agents desconhecidos por padrão?

- Nos logs do servidor, GPTBot ou ChatGPT-User aparecem nas últimas 4 semanas?

BLOCO B – Diagnóstico estratégico:

- Em uma frase, sua homepage descreve especificamente que problema sua empresa resolve, para quem e como?

- Alguém que nunca ouviu falar da sua empresa consegue entender em 10 segundos qual problema você resolve?

- Existem menções externas – publicações, reviews, fóruns – que confirmam o que você diz sobre si mesmo?

- Suas páginas usam a linguagem que o cliente usa para descrever o problema, não o vocabulário interno da empresa?

- Você tem conteúdo informacional que demonstra autoridade no problema que resolve, além dos produtos que vende?

| Portão | Diagnóstico | Como verificar | Impacto se bloqueado |

|---|---|---|---|

| Técnico | robots.txt bloqueia retrieval bots | Abrir seusite.com/robots.txt | Invisível para ChatGPT/Perplexity em tempo real |

| Técnico | CDN bloqueia GPTBot | curl -A "GPTBot" seusite.com | Invisível mesmo com robots.txt correto |

| Técnico | JavaScript oculta conteúdo | Google Rich Results Test | Conteúdo existe mas crawlers não veem |

| Estratégico | Posicionamento vago | Ler homepage em 10 segundos | IA não consegue recomendar sua marca |

| Estratégico | Sem validação externa | Buscar marca no ChatGPT | IA cita outros com mais menções de terceiros |

Quer saber em qual portão sua marca está presa? A Tropk.ai monitora como sua empresa aparece no ChatGPT, Perplexity e Google AI Overviews – e identifica as barreiras técnicas e estratégicas que bloqueiam sua visibilidade. Brasil é o 3º país em uso de ChatGPT. A maioria das marcas brasileiras não sabe se aparece lá. A Tropk existe para resolver isso.

Como aparecer no ChatGPT, Perplexity e Google AI Overviews

Como aparecer no ChatGPT e no Perplexity?

Para aparecer no ChatGPT e no Perplexity, sua marca precisa passar dois filtros. Primeiro, o técnico: garantir que seu robots.txt permite os user-agents de retrieval (ChatGPT-User, PerplexityBot, OAI-Searchbot), que seu CDN não os bloqueia, e que seu conteúdo não depende de JavaScript para aparecer no HTML. Segundo, o estratégico: ter conteúdo que articula claramente que problema você resolve, para quem, e ter menções externas que validam essa posição.

Devo bloquear o GPTBot no robots.txt?

Depende do objetivo. GPTBot opera em dois modos: treinamento (coleta dados para retreinar modelos futuros) e busca em tempo real (via ChatGPT-User). Bloquear o GPTBot de treinamento pode impedir que sua marca seja incorporada em versões futuras do ChatGPT, mas não afeta aparições em respostas atuais. O que não deve ser bloqueado são os crawlers de retrieval (ChatGPT-User, PerplexityBot, OAI-Searchbot): publishers que bloquearam esses perderam 14% do tráfego humano porque visitantes chegavam via referências de IA.

Por que o Reddit aparece mais no ChatGPT do que minha empresa?

Porque os crawlers do ChatGPT conseguem ler o Reddit sem obstáculos técnicos. Reddit não tem CDN agressivo bloqueando user-agents, não usa JavaScript para renderizar conteúdo principal, e tem robots.txt que permite crawlers de busca. Segundo análise da OtterlyAI de 1M+ citações, plataformas comunitárias (Reddit, Quora) capturaram 52,5% das citações de IA em jan-fev 2026. A vantagem deles é técnica, não apenas editorial.

Quantos sites têm barreiras técnicas que bloqueiam crawlers de IA?

73% dos sites têm pelo menos uma barreira técnica, segundo análise da OtterlyAI de mais de 1 milhão de citações em ChatGPT, Perplexity e Google AI Overviews (janeiro-fevereiro 2026). As principais barreiras são robots.txt configurado para rejeitar crawlers, CDNs bloqueando user-agents não-navegador, e JavaScript que impede a renderização. A maioria desses bloqueios é involuntária.

SEO tradicional ainda ajuda a aparecer em IA?

Sim, mas não resolve os dois portões. Conteúdo bem ranqueado no Google tem mais chance de ser rastreado por crawlers de IA, já que muitos usam o índice do Google como ponto de partida. Mas SEO tradicional não corrige o portão técnico (robots.txt, CDN, JavaScript) nem o portão estratégico (posicionamento para queries conversacionais). Aparecer em IA exige os dois portões abertos, além de uma boa base de SEO.

Vale a pena investir em visibilidade em IA se o tráfego ainda é pequeno?

Sim. Tráfego de LLMs cresceu 3x ao longo de 2025 e converte a 18% – acima da média de outros canais. O volume ainda é menor que SEO tradicional, mas o crescimento e a qualidade do tráfego justificam ação agora. Quem constrói visibilidade em IA neste momento tem vantagem de dados e de presença sobre quem vai entrar depois que o mercado consolidar.