Quando você digita uma pergunta no ChatGPT ou no Google AI Mode, a IA não faz uma busca. Ela faz dezenas. Cada uma buscando uma resposta diferente, para aspectos diferentes da sua pergunta, em fontes diferentes ao mesmo tempo. Isso é o que chamam de fanout queries – e é o motivo pelo qual a maioria das marcas brasileiras está invisível nas respostas de IA mesmo com SEO estabelecido.

A maioria das equipes de SEO continua otimizando para palavras-chave, enquanto a IA está gerando internamente centenas de sub-queries que não têm volume nenhum nessas ferramentas, mas são exatamente as que determinam quem aparece nas respostas.

Este artigo explica como o mecanismo funciona, o que cada plataforma faz de diferente, e o que você pode fazer agora para que seu conteúdo apareça. Se já quer saber como sua marca está hoje e as sub-queries para sua marca, a Tropk.ai mede isso.

Pontos Importantes

- Fanout queries são sub-queries geradas internamente pelas IAs para decompor uma única pergunta em múltiplas buscas paralelas.

- O Google AI Mode e o ChatGPT emite até centenas de sub-queries em modo Deep Search, e chegou ao Brasil em setembro de 2025.

- AI Mode gera em média 310 citações por resposta, contra 51 do AI Overviews – com apenas 13,7% de sobreposição entre as fontes (OtterlyAI, 730K pares de respostas).

- Queries submetidas ao AI Search têm 70-80 palavras em média, contra 3-4 palavras no Google tradicional.

- Conteúdo genérico não é citado. Para aparecer nas fanout queries, cada passagem do seu conteúdo precisa ser granularmente útil e independentemente recuperável.

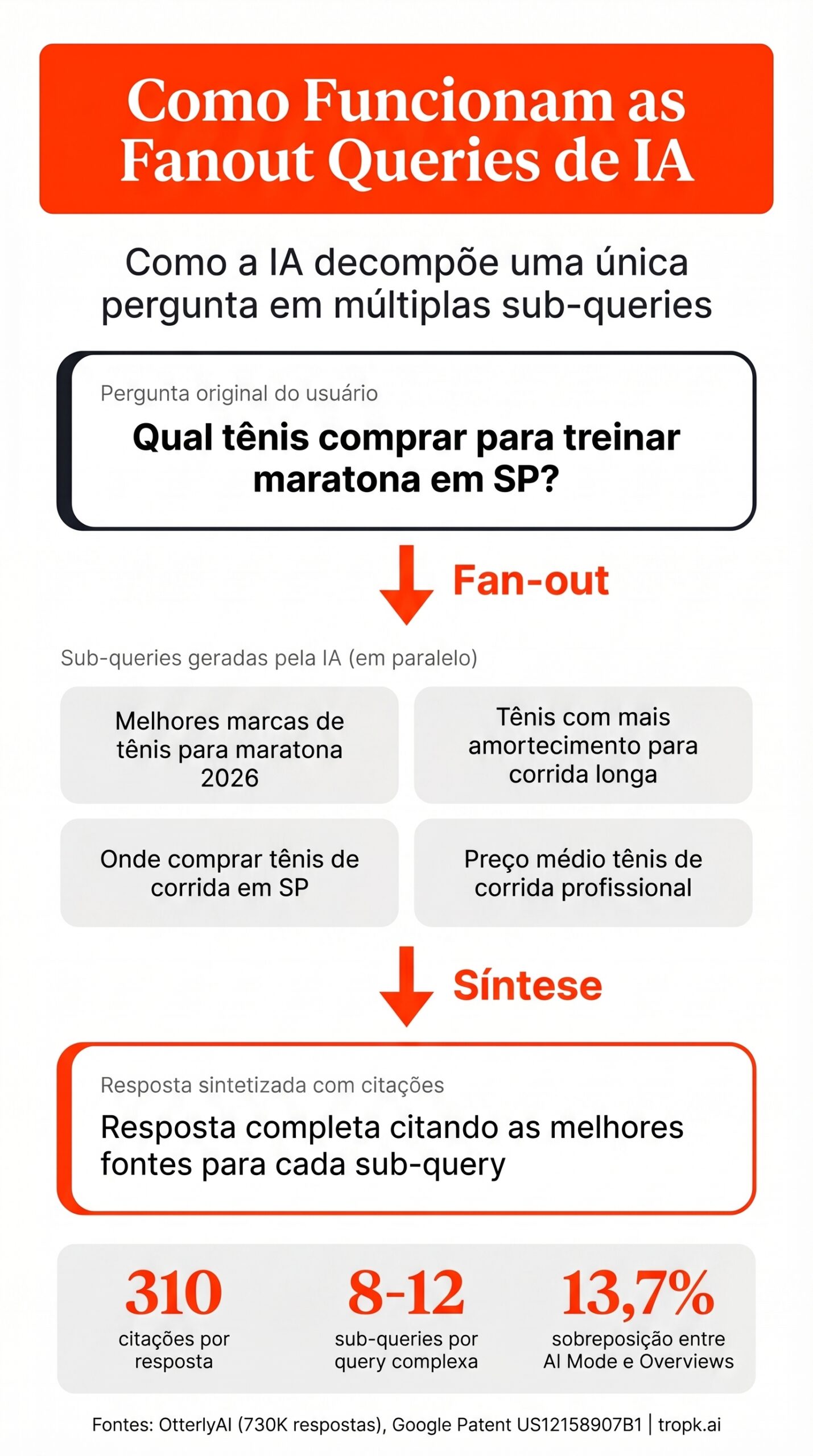

O que é uma fanout query

Fanout query é a técnica pela qual sistemas de busca com IA decompõem uma única pergunta do usuário em múltiplas sub-queries paralelas, cada uma buscando informação específica que depois é sintetizada numa única resposta com citações.

A palavra “fanout” descreve o movimento: uma pergunta abre em forma de leque, gerando ramificações que buscam ângulos diferentes do mesmo tema.

Definição e exemplo com contexto brasileiro

Imagine que alguém pesquisa no Google AI Mode: “qual tênis de corrida comprar para treinar maratona em São Paulo?”

O AI Mode não busca essa frase. Ele a decompõe. Gera sub-queries como:

- “melhores marcas de tênis para maratona 2026”

- “tênis com mais amortecimento para corrida longa”

- “custo médio tênis de corrida profissional no Brasil”

- “onde comprar tênis de corrida em São Paulo”

- “diferença tênis cushioned vs responsivo para maratonistas”

Cada sub-query busca uma fonte específica. A resposta final cita as melhores passagens de cada uma. Seu conteúdo pode ser citado mesmo que não apareça no top 10 do Google para a query original – desde que tenha a melhor resposta para uma das sub-queries específicas.

Como a Conductor Academy documentou: “Seu conteúdo pode ser citado não porque ranqueou para a keyword principal, mas porque tinha a melhor resposta para uma das sub-queries específicas.”

Esta é a mudança fundamental que o fan-out representa. SEO tradicional otimiza para a query. Fan-out exige otimização para o conjunto de sub-queries que a IA vai gerar a partir da query.

Como o mecanismo de fan-out funciona na prática

O mecanismo de fan-out está documentado em patentes do Google. A principal é a US12158907B1 “Thematic Search”, que descreve em detalhe o processo de geração de sub-queries, seleção de passagens relevantes e geração de sumários por LLM.

A diferença entre fan-out e busca tradicional

A diferença não é só no número de queries. É na natureza do processo inteiro.

| Aspecto | Busca tradicional | Fan-out (AI Search) |

|---|---|---|

| Número de queries | 1 | 8-12 por query complexa |

| Tipo de resultado | Lista de links ranqueados | Resposta sintetizada com citações |

| Como a marca aparece | Posição orgânica 1-10 | Citação em sub-query específica |

| O que determina a citação | PageRank + keywords | Passagem autocontida + autoridade tópica |

| Tamanho médio da query | 3-4 palavras | 70-80 palavras no AI Search |

Na busca tradicional, seu conteúdo compete por posição. No fan-out, seu conteúdo compete por ser extraível. São jogos diferentes.

E o dado de 70-80 palavras por query no AI Search – levantado pela iPullRank em parceria com SimilarWeb – revela algo importante: quem usa o AI Mode está fazendo perguntas muito mais complexas do que uma busca típica. Isso gera mais sub-queries, mais fontes consultadas, mais oportunidades de ser citado.

O processo em 4 etapas

A Conductor Academy mapeou o processo em quatro etapas que se repetem em todos os sistemas de AI search:

- Query decomposition: A IA analisa a pergunta inicial, determina intenção, complexidade e tipo de resposta necessária, e a divide em subtópicos e facetas.

- Parallel retrieval: Todas as sub-queries são executadas ao mesmo tempo – na web, no Knowledge Graph e em bancos de dados especializados como shopping graphs.

- Relevance assessment: Os resultados são avaliados por relevância e credibilidade da fonte. Passagens autocontidas têm vantagem.

- Synthesis: O LLM sintetiza tudo numa única resposta coerente, citando as fontes mais relevantes de cada sub-query.

A IA age como um pesquisador que primeiro define o que precisa saber, busca cada ponto separadamente, avalia a qualidade das fontes, e só então escreve a resposta. Marcas que aparecem são as que têm respostas claras para as perguntas específicas que esse pesquisador vai fazer.

Os 7 tipos de sub-queries que as IAs fazem

O SEO Happy Hour mapeou os 7 tipos de sub-queries com base nas patentes originais do Google. Esta é a taxonomia mais completa disponível em português:

| Tipo | Quando acontece | O que busca | Exemplo | Patente |

|---|---|---|---|---|

| Pesquisas relacionadas | Coocorrência no Knowledge Graph | Expande recuperação de informação | “SUVs elétricos híbridos mais avaliados” | WO2024064249A1, US20240362093A1 |

| Pesquisas implícitas | Inferência com base na formulação | Inclui necessidades mais profundas | “carros elétricos com maior autonomia” (quando se pergunta sobre custo) | WO2024064249A1, US20240289407A1 |

| Consultas comparativas | Classificador detecta tomada de decisão | Aciona conteúdo contrastivo | “Rivian R1S vs. Tesla Model X” | WO2024064249A1, US20240362093A1 |

| Pesquisas recentes | Consultas anteriores na sessão | Personaliza e mantém contexto | Baseado no histórico da sessão atual | US20240289407A1 |

| Pesquisas personalizadas | Memória de longo prazo do usuário | Reflete contexto e comportamento passado | “carros elétricos com desconto em Curitiba” | WO2025102041A1, US20240289407A1 |

| Pesquisas reformuladas | LLM reformula o prompt original | Aumenta diversidade lexical na busca | “qual o melhor SUV elétrico” | WO2024064249A1, WO2025102041A1 |

| Expansão de entidade | Relações no Knowledge Graph | Amplia ou especifica usando entidades | “avaliações do Model Y”, “VW ID.4 vs Hyundai Ioniq” | WO2024064249A1, US20240362093A1 |

As sub-queries implícitas e reformuladas merecem atenção especial. São geradas sem o usuário saber, a partir de inferências sobre o que ele provavelmente quer dizer. Se seu conteúdo só responde à pergunta literal que foi digitada, ele fica fora das sub-queries mais valiosas.

Fan-out no Google AI Mode: o que mudou desde setembro de 2025 no Brasil

O Google AI Mode não é o AI Overviews com mais recursos. São produtos diferentes, com comportamentos diferentes e estratégias de otimização diferentes.

E desde 8 de setembro de 2025, ele está disponível no Brasil, em português, alimentado pelo Gemini 2.5. O Brasil lidera a adoção de IA no ecossistema Google, com mais de 7 milhões de desenvolvedores usando o Gemini. Não é um mercado secundário – é um mercado prioritário.

A queda nos cliques já é documentada. O Ahrefs (jan/2026) mediu redução de 58% no CTR do 1º resultado orgânico quando AI Overviews aparecem, em análise de 300 mil keywords. O AI Mode intensifica esse efeito: se o AI Mode responde antes de qualquer clique, a lista de resultados orgânicos se torna secundária.

A boa notícia é que o AI Mode também cita muito mais fontes. E isso cria uma oportunidade que o SEO tradicional não tinha.

Deep Search: quando a IA faz centenas de sub-queries

O modo Deep Search das IAs é onde o mecanismo de fan-out opera em escala. Robby Stein, VP de Produto do Google para Search, declarou em entrevista ao SEJ: o Deep Search pode emitir “dezenas ou até centenas” de sub-queries em segundo plano.

A própria experiência dele com o Deep Search resume bem o que esse volume de sub-queries produz:

“It spent, I don’t know, like a few minutes looking up information and it gave me this incredible response. Here are how the ratings would work and here are specific safes you can consider and here’s links and reviews to click on to dig deeper.”

Alguns minutos. Centenas de sub-queries. Uma resposta que cita múltiplos especialistas, avaliações, comparativos e recomendações específicas.

O Shopping Graph que alimenta as sub-queries de compra tem escala coerente com isso: 50 bilhões de produtos, atualizado 2 bilhões de vezes por hora. Quando alguém pergunta sobre um produto no Deep Search, o Google está consultando esse banco em tempo real.

Marcas que não aparecem no top resultado para nenhuma sub-query específica do seu tema ficam de fora desse processo inteiro. Não importa quanto conteúdo elas tenham publicado.

Como funciona o fan-out em cada plataforma de IA

Cada plataforma de AI search usa fanout queries de forma diferente: o Google AI Mode gera em média 310 citações por resposta, o AI Overviews gera 51, o Perplexity executa cerca de 5 sub-queries por consulta complexa, e o ChatGPT tem limite documentado de 5 pesquisas simultâneas (OtterlyAI, 730K pares de respostas). A estratégia de otimização precisa considerar essas diferenças – o que funciona para AI Overviews cobre apenas 13,7% das fontes que o AI Mode usa.

| Plataforma | Citações médias por resposta | Sub-queries típicas | Transparência | Como otimizar |

|---|---|---|---|---|

| Google AI Mode | 310 (OtterlyAI) | Até centenas (Deep Search) | Baixa | Clusters + schema + EEAT (Experience, Expertise, Authoritativeness, Trustworthiness) |

| Google AI Overviews | 51 (OtterlyAI) | Moderado | Baixa | Top 10 orgânico + dados verificáveis |

| Perplexity | Variável | ~5 por consulta complexa | Alta (mostra as queries) | Dados primários + citações diretas |

| ChatGPT | Variável | 8-12 sub-queries | Baixa | FAQ schema + conteúdo atômico |

| Claude | N/A (sem busca em tempo real) | Sem sub-queries web | N/A | Dados de treinamento + documentos |

Google AI Mode vs AI Overviews: não são a mesma coisa

O dado mais revelador sobre a diferença entre os dois vem de uma análise do OtterlyAI com 730 mil pares de respostas:

- AI Mode: média de 310 citações por resposta

- AI Overviews: média de 51 citações por resposta

- Sobreposição de fontes entre os dois: apenas 13,7%

- AI Mode: respostas 4x mais longas que AI Overviews

- AI Mode: menciona 3,3 entidades por resposta, contra 1,3 no AI Overviews

Traduzindo: se você otimizou só para AI Overviews, está fora de 87% das fontes que o AI Mode usa. São produtos muito diferentes com lógicas de citação muito diferentes. Ter uma estratégia única para “aparecer em IA” é como ter uma estratégia única para “aparecer em Google e Instagram” – você vai mal nos dois.

Perplexity: transparência nas sub-queries

O Perplexity tem uma característica que os outros não têm: mostra o processo. Quando executa sub-queries, o usuário pode ver quais buscas foram feitas e quais fontes foram consultadas.

A escala é significativa: 200 milhões de queries por dia, com latência mediana de 358ms em 200+ bilhões de URLs indexadas. Em consultas complexas, executa em torno de 5 sub-queries. O diferencial é que cada citação vem com link direto – o usuário vê exatamente qual fonte foi usada.

Para aparecer no Perplexity, dados primários com fontes verificáveis têm vantagem clara. A plataforma favorece conteúdo que pode ser hiperlinked de volta à origem.

ChatGPT e Claude: mecanismos menos transparentes

O ChatGPT opera com um sistema de sub-queries, de 8 a 12 por mensagem enviada. Mas em modo de busca profunda, já foi documentado revisando mais de 49 páginas em um único teste.

Claude não faz sub-queries via web em tempo real – usa recuperação de documentos via ferramentas externas quando configurado para isso. Para aparecer no Claude, o foco é nos dados de treinamento e em ser fonte citável em documentos que o modelo conhece.

Por que o conteúdo da maioria das marcas não aparece nas fanout queries

O paradoxo das fanout queries é este: a keyword “fanout queries ia” tem volume zero nas ferramentas de SEO. Mas é exatamente o tipo de sub-query que o Google AI Mode vai gerar internamente quando alguém pergunta “como aumentar visibilidade em IA” ou “por que minha marca não aparece no ChatGPT”.

Marcas que otimizam para volume de busca clássico estão invisíveis nas queries que realmente importam para citação. A pesquisa da AirOps com 548 mil páginas comprovou que 95% das queries que geram citações de IA têm volume zero em ferramentas tradicionais.

O segundo problema é o conteúdo genérico. A iPullRank foi direta: “Generic, thematic content no longer converts to visibility in search. Your passages must be granularly useful and independently retrievable.”

O AI Mode não quer a página inteira. Quer passagens específicas que respondam sub-queries específicas. Se a sua página tem um parágrafo sobre o preço de tênis de corrida mas ele não é autocontido – depende do parágrafo anterior para fazer sentido – ele não vai ser extraído.

Tem mais: o Ahrefs mediu queda de 58% no CTR do 1º resultado orgânico com AI Overviews. O AI Mode, com respostas 4x mais longas e muito mais citações, intensifica esse efeito. Cada posição orgânica perdeu valor de clique. Ser citado nas sub-queries virou o novo “aparecer no top 3”.

Entender por que marcas não aparecem em IA geralmente revela os mesmos problemas: conteúdo sem estrutura extraível, ausência de autoridade tópica, e falta de dados verificáveis com fontes diretas.

O que fazer para aparecer nas fanout queries

Aparecer nas fanout queries exige quatro mudanças na forma como conteúdo é produzido: cobertura tópica ampla por clusters, passagens extraíveis independentemente, schema markup para facilitar a leitura pelas IAs, e cobertura explícita das sub-queries que os usuários não digitam mas as IAs inferem. Nenhuma das quatro funciona isolada – as marcas que aparecem sistematicamente fazem as quatro ao mesmo tempo.

1. Construir autoridade tópica com clusters de conteúdo

Para aparecer nas sub-queries de um tema, a marca precisa cobrir o espectro inteiro de perguntas relacionadas. A lógica é simples: se o AI Mode gera 8-12 sub-queries para uma pergunta complexa e você tem conteúdo específico para 6 delas, vai ser citado múltiplas vezes. Se tem 1 artigo genérico, provavelmente não vai ser citado nenhuma vez.

O mapeamento de GEO, AEO e SEO como disciplinas complementares é o ponto de partida. Cada cluster de conteúdo precisa cobrir o tema central com um artigo pillar e artigos de suporte para cada sub-tema. Esses artigos de suporte são os que aparecem nas sub-queries específicas.

Na prática: liste as 10-15 perguntas mais específicas que um usuário pode fazer sobre o seu tema central. Cada uma é uma sub-query candidata. Se você não tem conteúdo para uma delas, não vai aparecer quando ela for gerada.

Na Tropk.ai, inclusive, conseguimos mapear exatamente quais sub-queries estão sendo geradas para cada prompt e tema monitorado, permitindo identificar com precisão quais perguntas e onde ainda existem gaps de cobertura dentro do cluster.

2. Criar conteúdo atômico e extraível

“Conteúdo atômico” é o conceito que muda a lógica de produção.

Cada parágrafo deve poder ser extraído sem perder contexto. Dados, nome da fonte, link – tudo junto na mesma passagem. Uma definição deve ser autocontida. Uma estatística deve vir com o contexto de quando foi coletada, por quem, e a fonte linkada.

Pense assim: se um LLM extrair apenas esse parágrafo, sem nada ao redor, o leitor vai entender o dado completo? Se a resposta for não, o parágrafo não está otimizado para fan-out.

Para aprender o que torna um conteúdo citável, o guia de criação de conteúdo citável por IAs detalha os elementos estruturais que aumentam a probabilidade de citação.

3. Usar schema markup para facilitar a extração

Schema markup ajuda o AI Mode a entender a estrutura do conteúdo e extrair passagens relevantes com mais precisão.

Apenas 10,5% das páginas citadas por IA usam FAQ schema – uma oportunidade enorme para quem estruturar o conteúdo agora. Páginas com 3 ou mais tipos de schema têm 13% mais probabilidade de citação [fonte a confirmar].

Os tipos mais relevantes para fan-out:

- FAQ schema: cada pergunta/resposta é uma sub-query potencial autocontida

- HowTo schema: cada etapa é uma passagem extraível para sub-queries de processo

- Article schema com `mainEntity`: ajuda o modelo a entender o tema central e suas entidades relacionadas

Para implementar corretamente, o guia técnico de otimização para IA cobre os tipos de schema mais relevantes para citação.

4. Cobrir as sub-queries implícitas

As sub-queries implícitas são as mais difíceis de cobrir e as mais valiosas. Elas são geradas pelo AI Mode mesmo quando o usuário não as digitou – são inferências sobre o que ele provavelmente quer saber além da pergunta literal.

Para identificar as sub-queries implícitas do seu tema:

- Use a Tropk.ai para mapear automaticamente as sub-queries geradas pelos modelos de IA para cada prompt monitorado, identificando quais perguntas derivadas estão surgindo e quais delas sua marca ainda não cobre

- Use o AlsoAsked – criado por Mark Williams-Cook, gera uma árvore de perguntas relacionadas ao seus temas

- Analise o “People Also Ask” da SERP para as suas keywords principais

- Teste diretamente nos LLMs: pergunte sobre o seu tema e observe quais perguntas complementares a IA sugere

Cada pergunta dessas árvores é uma sub-query candidata. Se você tem conteúdo específico para ela, aumenta a chance de ser citado quando ela for gerada.

Como monitorar sua presença nas fanout queries

Saber se você está aparecendo nas sub-queries geradas pelas IAs não é trivial. As plataformas não mostram quais sub-queries foram feitas para chegar a você – com exceção do Perplexity.

Três formas práticas de monitorar:

1. Testar diretamente nos LLMs: Formule as perguntas que seu público-alvo provavelmente faz e veja se sua marca aparece nas respostas. “Quais as melhores ferramentas de [sua categoria]?”, “Quem são os especialistas em [seu tema]?”, “O que [seu tema] tem de diferente no Brasil?”. Documente os resultados ao longo do tempo.

2. Monitorar AI referral traffic no GA4: O Google AI Mode começa a gerar tráfego referencial que aparece nas suas fontes de tráfego. Criar um segmento específico para tráfego vindo de domínios de IA permite acompanhar a evolução.

3. Ferramentas de monitoramento de visibilidade em IA: A Tropk.ai foi desenvolvida para isso: monitorar em quais respostas de IA sua marca aparece, para quais sub-queries, e quais concorrentes estão tomando espaço no seu nicho. Diferente de testar manualmente, o monitoramento contínuo revela tendências, identifica onde você sumiu, e mostra onde os concorrentes estão ganhando terreno. Conheça a Tropk.ai →

Para um contexto mais amplo sobre como medir visibilidade de marca em IA com métricas acionáveis, vale ler o guia completo.

O ponto central é este: se você não está medindo, está voando às cegas num ambiente que muda todo mês. O terreno ainda está sendo disputado. Marcas que mapearem sua presença agora têm vantagem real sobre as que vão acordar para o problema em 2027.

FAQ

O que é fanout query?

Fanout query é a técnica usada por sistemas de busca com IA para decompor uma única pergunta do usuário em múltiplas sub-queries paralelas. Cada sub-query busca um aspecto específico da pergunta original. Os resultados são sintetizados numa única resposta com citações das melhores fontes para cada sub-query.

Fanout queries são usadas só no Google AI Mode?

Não. Todas as principais plataformas de AI search usam alguma variação de fan-out, mas com diferenças significativas. O Google AI Mode pode emitir centenas de sub-queries em modo Deep Search. O Perplexity usa em torno de 5 sub-queries por consulta complexa e mostra o processo para o usuário. O ChatGPT usa de 5 a 12 sub-queries. O Claude não faz buscas web em tempo real e opera com recuperação de documentos.

Como posso ver as sub-queries que o Google gera?

O Google não mostra as sub-queries geradas pelo AI Mode diretamente. O Perplexity é a exceção: exibe quais buscas foram feitas durante cada consulta. Para o Google, as formas mais práticas são: usar o AlsoAsked para visualizar o espaço de perguntas relacionadas ao seu tema, analisar o People Also Ask da SERP, e testar diretamente no AI Mode observando quais fontes aparecem nas respostas para perguntas do seu tema. Utilize a tropk.ai para saber exatamente quais sub-queries foram utilizadas em cada plataforma.

Quais tipos de conteúdo aparecem mais nas fanout queries?

Conteúdo atômico – passagens que respondem uma pergunta específica de forma completa e autocontida – tem vantagem sobre conteúdo genérico. Dados com fontes verificáveis inline (não em lista de referências no final), FAQ schema para perguntas frequentes, e HowTo schema para processos passo a passo são os formatos com maior probabilidade de extração. Páginas com 3 ou mais tipos de schema têm 13% mais probabilidade de citação.

O AI Mode é diferente do AI Overviews?

Sim, são produtos distintos com comportamentos muito diferentes. O AI Mode gera em média 310 citações por resposta, contra 51 do AI Overviews (OtterlyAI, 730K pares). Apenas 13,7% das fontes citadas se sobrepõem entre os dois. O AI Mode produz respostas 4x mais longas, menciona 2,5x mais entidades, e usa o modo Deep Search para consultas complexas. Otimizar só para AI Overviews deixa de fora 87% das fontes que o AI Mode usa.

Como faço para monitorar se minha marca está aparecendo nas IAs?

Três formas principais: testar diretamente nos LLMs com perguntas do seu nicho, monitorar tráfego referencial de IA no GA4, e usar ferramentas especializadas como a Tropk.ai, que faz monitoramento contínuo da sua visibilidade nas principais plataformas de AI search e compara sua presença com a de concorrentes. O monitoramento manual funciona para validação inicial, mas não escala para acompanhar mudanças semanais em como as IAs citam fontes.